Anúncios

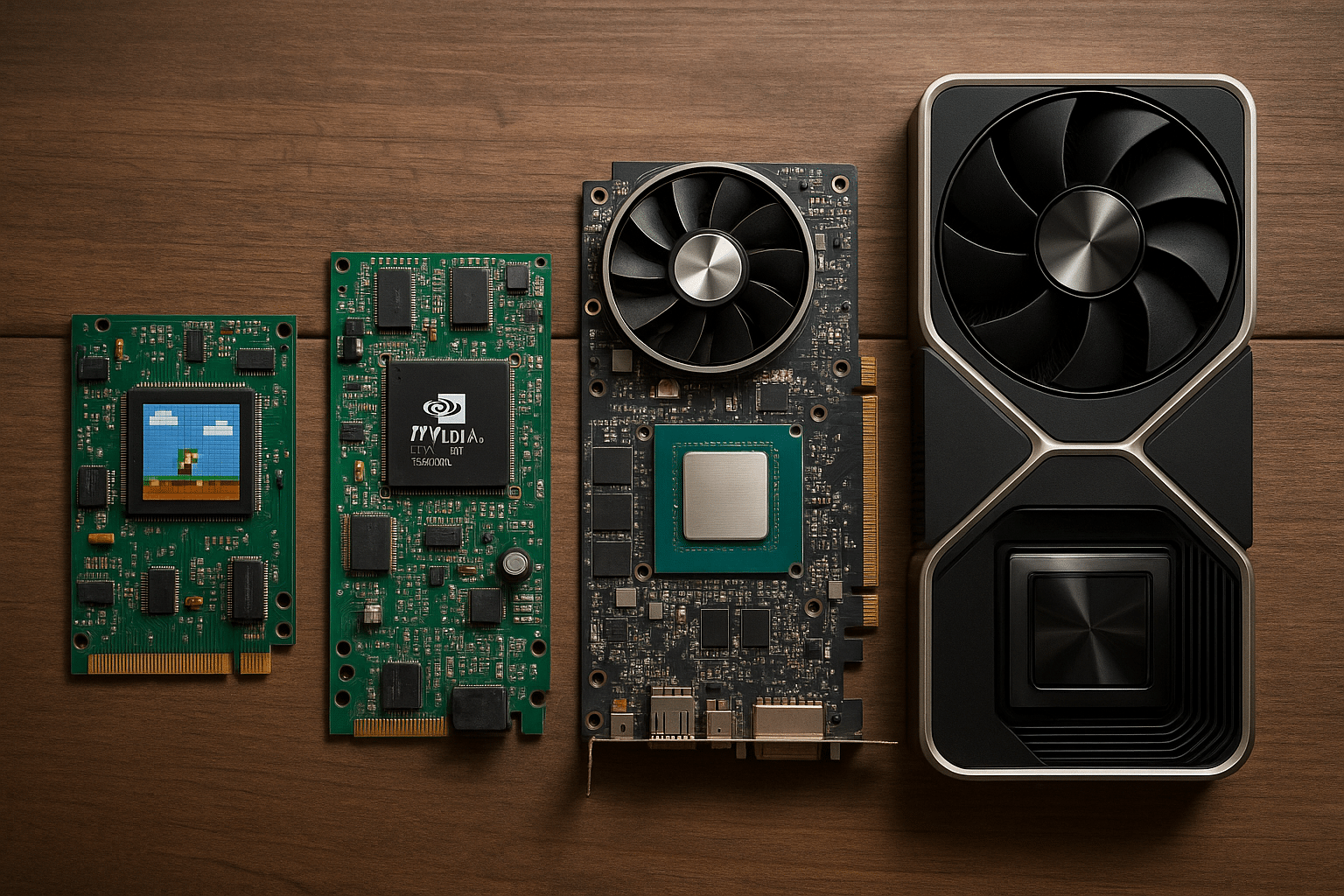

A trajetória tecnológica das placas de vídeo representa uma das evoluções mais significativas da computação moderna. Desde os primeiros adaptadores gráficos monocromáticos até os processadores especializados em inteligência artificial, esse componente transformou-se radicalmente.

O que inicialmente servia apenas para exibir caracteres em monitores CRT evoluiu para sistemas complexos capazes de processar trilhões de operações por segundo. Esta metamorfose tecnológica acompanhou e, em muitos casos, viabilizou os avanços mais importantes da era digital.

Anúncios

🖥️ Os primórdios: quando a imagem era apenas texto

As primeiras placas gráficas surgiram na década de 1960, projetadas exclusivamente para exibir caracteres alfanuméricos. O IBM 2250, lançado em 1964, representa um dos marcos iniciais dessa tecnologia. Operava com resoluções extremamente limitadas e capacidade de renderização vetorial básica.

Durante os anos 1970, o padrão MDA (Monochrome Display Adapter) da IBM estabeleceu as bases para adaptadores gráficos em computadores pessoais. Com resolução de 720×350 pixels e suporte apenas para texto monocromático, essa tecnologia atendia adequadamente às necessidades computacionais da época.

Anúncios

O CGA (Color Graphics Adapter), introduzido em 1981, marcou a transição para gráficos coloridos. Apesar de suas limitações – paleta de 4 cores simultâneas em resolução de 320×200 pixels – representou um salto qualitativo significativo. Aplicações comerciais e os primeiros jogos começaram a explorar essas capacidades gráficas rudimentares.

A revolução do EGA e VGA

O padrão EGA (Enhanced Graphics Adapter), lançado em 1984, expandiu as possibilidades cromáticas para 16 cores simultâneas em resolução de 640×350 pixels. Esta evolução possibilitou interfaces gráficas mais sofisticadas e aplicações empresariais visualmente mais ricas.

Em 1987, o VGA (Video Graphics Array) estabeleceu um novo paradigma. Com resolução de 640×480 pixels e suporte para 256 cores, tornou-se o padrão dominante por mais de uma década. A arquitetura VGA introduziu conceitos fundamentais como buffers de vídeo dedicados e controladores de sincronização aprimorados.

⚡ A era dos aceleradores gráficos 2D

A década de 1990 testemunhou o surgimento dos primeiros aceleradores gráficos dedicados. Empresas como S3, Tseng Labs e Cirrus Logic desenvolveram chips especializados para acelerar operações bidimensionais comuns em interfaces gráficas.

O S3 Trio64, lançado em 1995, integrava controlador VGA, acelerador 2D e suporte para resoluções superiores em um único chip. Esta integração reduziu custos e melhorou significativamente o desempenho em operações como movimentação de janelas, renderização de fontes e preenchimento de áreas.

Os aceleradores 2D implementavam funções específicas em hardware:

- BitBlt (Block Image Transfer) para movimentação rápida de blocos de pixels

- Line drawing acelerado para interfaces gráficas

- Pattern fill para preenchimento eficiente de áreas

- Hardware cursor para movimentação suave do ponteiro

- Color expansion para renderização otimizada de texto

🎮 O nascimento da renderização 3D em tempo real

O ano de 1996 marca uma inflexão histórica com o lançamento da 3dfx Voodoo Graphics. Exclusivamente dedicada à aceleração 3D, esta placa operava como coproduto complementar à placa 2D existente. Implementava as APIs Glide e fornecia desempenho sem precedentes em jogos tridimensionais.

A arquitetura da Voodoo baseava-se em processamento paralelo de pixels e texturas. Com 4MB de memória EDO dedicada e clock de 50MHz, alcançava taxas de preenchimento de 50 milhões de pixels por segundo – revolucionário para os padrões da época.

A consolidação das GPUs modernas

A NVIDIA revolucionou o mercado em 1999 com a GeForce 256, primeiro processador gráfico denominado oficialmente como GPU (Graphics Processing Unit). Integrava Transform & Lighting (T&L) em hardware, eliminando a necessidade de processamento dessas operações pela CPU.

Esta arquitetura implementava o pipeline gráfico completo:

- Transformação de vértices em hardware

- Cálculos de iluminação por vértice

- Clipping e projeção acelerados

- Rasterização de alta performance

- Texturização multi-stage

- Alpha blending e efeitos de transparência

A ATI Technologies (posteriormente adquirida pela AMD) respondeu com a linha Radeon. A Radeon 9700 Pro, lançada em 2002, introduziu suporte completo para DirectX 9 e arquitetura de pipeline programável, possibilitando shaders complexos e efeitos visuais avançados.

🔧 A era dos shaders programáveis

A transição de pipelines fixos para totalmente programáveis transformou as GPUs de processadores especializados em plataformas computacionais flexíveis. Os shaders programáveis permitiram aos desenvolvedores implementar algoritmos customizados diretamente no hardware gráfico.

O DirectX 9, lançado em 2002, formalizou a programação de shaders através das linguagens HLSL (High-Level Shading Language) e posteriormente GLSL (OpenGL Shading Language). Esta abstração permitiu programação em alto nível mantendo performance próxima ao código assembly.

Vertex Shaders e Pixel Shaders

Os Vertex Shaders processam cada vértice individualmente, aplicando transformações geométricas, cálculos de iluminação e preparação de dados para rasterização. A flexibilidade dessa programação possibilitou efeitos como deformação procedural, animação por vértice e tessellation dinâmica.

Os Pixel Shaders (ou Fragment Shaders) executam para cada pixel renderizado, determinando cor final, aplicando texturas múltiplas, calculando iluminação por pixel e implementando efeitos complexos como normal mapping, parallax occlusion e sub-surface scattering.

⚙️ Arquiteturas unificadas e computação paralela massiva

Em 2006, a NVIDIA lançou a arquitetura Tesla com a GeForce 8800 GTX, primeira GPU com arquitetura de shader unificada. Substituiu unidades especializadas por processadores de stream programáveis capazes de executar qualquer tipo de shader.

Esta arquitetura organizava-se em multiprocessadores de stream (SM), cada um contendo múltiplos processadores de stream capazes de executar threads em paralelo. A GeForce 8800 GTX integrava 128 processadores de stream organizados em 16 multiprocessadores.

Características técnicas fundamentais incluíam:

- Clock shader independente operando em frequências superiores

- Cache L1 por multiprocessador e L2 compartilhado

- Memória compartilhada programável por bloco de threads

- Suporte para operações atômicas em memória

- Precisão configurável (FP32, FP64, INT32)

💻 GPGPU: computação de propósito geral em GPUs

O reconhecimento do potencial computacional das GPUs além de gráficos originou o conceito de GPGPU (General-Purpose computing on Graphics Processing Units). A arquitetura paralela massiva das GPUs mostrou-se ideal para algoritmos paralelizáveis.

A NVIDIA formalizou esse paradigma com o lançamento do CUDA (Compute Unified Device Architecture) em 2007. Esta plataforma fornecia API de programação em C/C++ para acesso direto aos recursos computacionais da GPU, abstraindo complexidades do hardware gráfico.

OpenCL e a padronização multiplataforma

O Khronos Group desenvolveu o OpenCL como padrão aberto para computação heterogênea. Lançado em 2009, permite programação unificada para GPUs de diferentes fabricantes, CPUs multi-core e outros aceleradores especializados.

Aplicações GPGPU expandiram-se dramaticamente em domínios como:

- Simulações científicas de dinâmica molecular e climática

- Processamento de sinais digitais em tempo real

- Análise de dados massivos e business intelligence

- Renderização fotorrealística e ray tracing

- Criptografia e mineração de criptomoedas

- Compressão e transcodificação de vídeo

🤖 Machine Learning e o renascimento das GPUs

A explosão do deep learning a partir de 2012 transformou GPUs em componentes essenciais para inteligência artificial. O trabalho seminal de Alex Krizhevsky utilizando GPUs para treinar redes neurais profundas demonstrou acelerações de 10-50x comparadas a implementações em CPU.

A arquitetura massivamente paralela das GPUs alinha-se perfeitamente com operações matriciais fundamentais em redes neurais. Multiplicações matriz-matriz e convoluções podem ser decompostas em milhares de operações independentes executadas simultaneamente.

Tensor Cores e arquiteturas especializadas

A NVIDIA introduziu Tensor Cores na arquitetura Volta (2017), unidades especializadas para multiplicações de matrizes em precisão reduzida. Executam operações de multiplicação-acumulação 4×4 em um único ciclo, otimizadas especificamente para cargas de trabalho de deep learning.

As gerações subsequentes expandiram capacidades:

| Arquitetura | Ano | Tensor Core Gen | Precisões Suportadas | Performance (TFLOPS) |

|---|---|---|---|---|

| Volta | 2017 | 1ª Geração | FP16, FP32 | 125 (FP16) |

| Turing | 2018 | 2ª Geração | FP16, INT8, INT4 | 130 (FP16) |

| Ampere | 2020 | 3ª Geração | FP64, TF32, BF16, FP16, INT8 | 312 (TF32) |

| Hopper | 2022 | 4ª Geração | FP64, FP32, TF32, FP16, BF16, FP8, INT8 | 1000 (FP8) |

🌟 Ray Tracing em tempo real: simulando a física da luz

A arquitetura Turing (2018) introduziu RT Cores, unidades dedicadas para aceleração de ray tracing. Esta técnica simula o comportamento físico da luz, calculando reflexões, refrações e sombras através de traçado de raios.

Cada RT Core implementa estruturas BVH (Bounding Volume Hierarchy) em hardware, acelerando testes de interseção raio-triângulo. A arquitetura processa milhões de raios por segundo, viabilizando iluminação global em tempo real previamente restrita a renderização offline.

DLSS e reconstrução por inteligência artificial

O DLSS (Deep Learning Super Sampling) utiliza redes neurais treinadas para reconstruir imagens de alta resolução a partir de entradas de resolução inferior. Renderiza internamente em resolução reduzida e aplica upscaling inteligente, mantendo qualidade visual enquanto multiplica performance.

A terceira geração (DLSS 3) introduziu Frame Generation, criando frames intermediários completamente sintetizados pela rede neural. Esta técnica potencialmente duplica framerates sem impacto proporcional no processamento de geometria.

🔬 Especializações contemporâneas e futuro

As GPUs modernas integram múltiplos processadores especializados coexistindo em um único die. Além de CUDA cores tradicionais, incorporam Tensor Cores para IA, RT Cores para ray tracing, encoders/decoders de vídeo dedicados e engines de processamento de imagem.

A AMD desenvolveu arquiteturas competitivas com as linhas RDNA para gaming e CDNA para computação. A arquitetura RDNA 3 implementa chiplet design, segregando funcionalidades em dies especializados conectados por interlinks de alta velocidade.

Memória de alta largura de banda

O gargalo de memória torna-se crítico em cargas modernas. HBM (High Bandwidth Memory) empilha dies de memória verticalmente, conectando-se à GPU através de interposers de silício. A HBM3 alcança larguras de banda superiores a 3TB/s, essencial para alimentar milhares de cores de processamento.

A GDDR6X, utilizada em GPUs consumer high-end, implementa modulação PAM4 (Pulse Amplitude Modulation) transmitindo 2 bits por ciclo. Alcança velocidades de 21 Gbps por pin, fornecendo até 1TB/s de largura de banda agregada.

🚀 Inteligência artificial generativa e cargas emergentes

Modelos de linguagem de grande escala (LLMs) e difusão generativa representam as cargas de trabalho mais exigentes contemporâneas. O GPT-3 utiliza 175 bilhões de parâmetros; seu treinamento consumiu milhares de GPUs operando por meses.

Inferência em tempo real desses modelos requer hardware especializado. GPUs datacentre como A100 e H100 fornecem memória massiva (80GB+) e interconexões NVLink para escalabilidade multi-GPU. Estas configurações processam milhões de tokens por segundo em aplicações de produção.

Eficiência energética e sustentabilidade

O consumo energético tornou-se preocupação primária. GPUs high-end alcançam TDPs de 450W-600W, exigindo soluções térmicas sofisticadas. Arquiteturas futuras enfatizam eficiência computacional através de precisões reduzidas, sparsity acceleration e power gating granular.

Técnicas como quantização pós-treinamento reduzem precisão de FP32 para INT8 ou INT4, mantendo acurácia enquanto multiplicam throughput e reduzem consumo. Pruning estruturado elimina pesos redundantes, diminuindo operações necessárias.

🎯 Convergência hardware-software e ecossistemas

O desempenho moderno depende criticamente da otimização de software. Frameworks como PyTorch e TensorFlow implementam operações específicas para hardware subjacente. Bibliotecas como cuDNN, cuBLAS e TensorRT fornecem implementações altamente otimizadas de primitivas computacionais.

Compiladores especializados como XLA (Accelerated Linear Algebra) e TVM otimizam grafos computacionais, fundindo operações, minimizando transferências de memória e explorando paralelismo específico do hardware. Esta co-otimização hardware-software multiplica performance efetiva.

🔮 Perspectivas tecnológicas e desafios futuros

A trajetória futura aponta para maior especialização heterogênea. Chiplets especializados coexistirão em packages unificados, cada um otimizado para cargas específicas. Interconexões fotônicas prometem larguras de banda terabits com latências reduzidas, viabilizando desagregação de recursos.

Computação neuromórfica representa paradigma radicalmente distinto, emulando estruturas neurais biológicas. Processadores como Intel Loihi implementam neurônios e sinapses em hardware, oferecendo eficiência superior para certas cargas de IA.

A computação quântica, embora ainda experimental, pode eventualmente complementar GPUs em problemas específicos. Algoritmos quânticos prometem aceleração exponencial em otimização, simulação molecular e criptografia.

A evolução das placas de vídeo reflete perfeitamente a progressão tecnológica acelerada das últimas décadas. De simples adaptadores monocromáticos a supercomputadores especializados, esses dispositivos transcenderam sua função original, tornando-se fundamentais para inteligência artificial, computação científica e criação de conteúdo digital. O futuro promete especializações ainda maiores, eficiência energética aprimorada e capacidades computacionais que continuarão redefinindo os limites do possível na computação moderna.