Anúncios

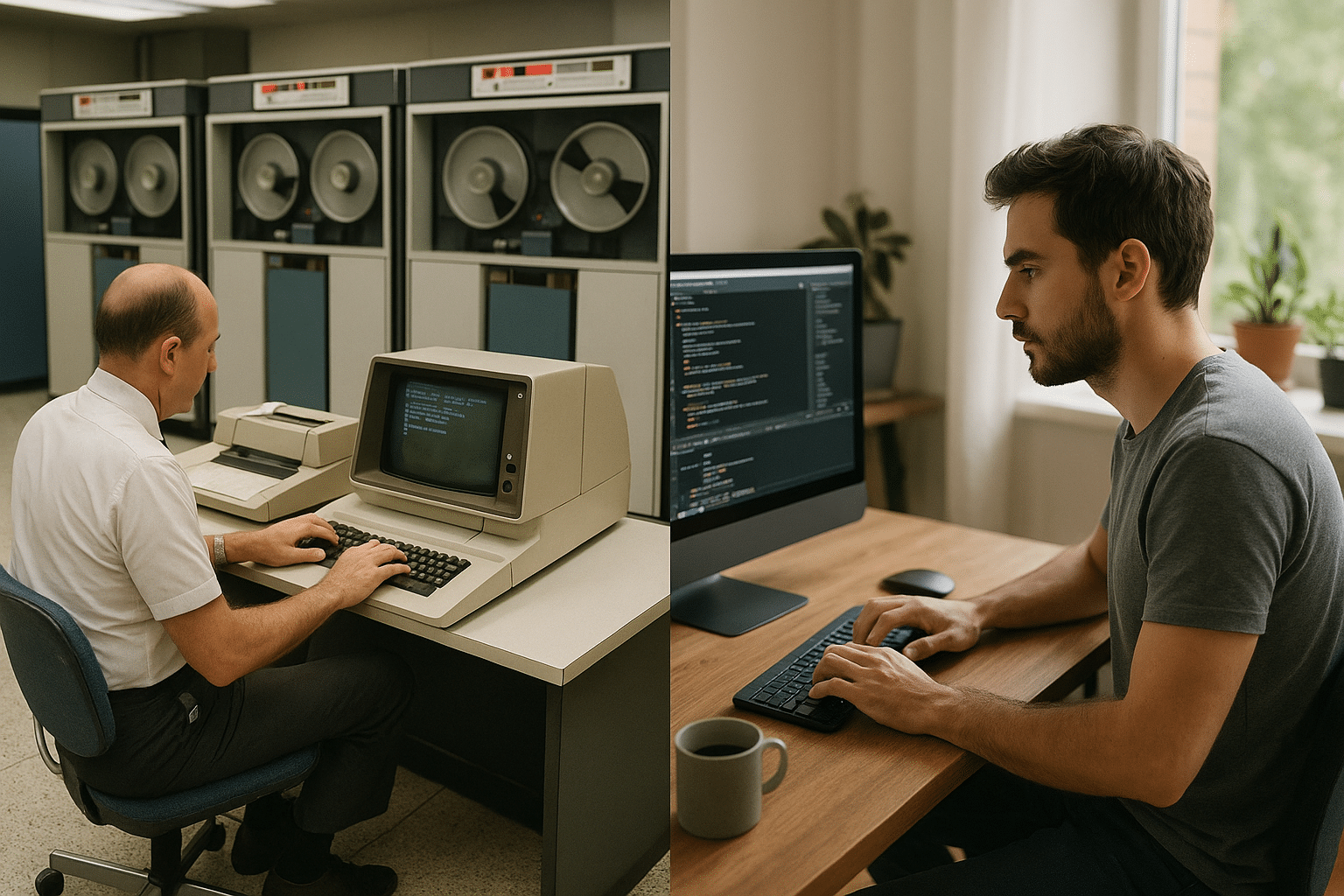

A transformação da computação de sistemas centralizados em mainframes para computadores pessoais representa uma das mudanças mais profundas da história tecnológica moderna.

Esta transição não apenas democratizou o acesso à tecnologia computacional, mas redefiniu completamente a arquitetura de sistemas, modelos de negócio e a própria relação entre humanos e máquinas. Compreender os aspectos técnicos desta evolução é fundamental para profissionais que atuam em desenvolvimento de software, arquitetura de sistemas e gestão de infraestrutura tecnológica.

Anúncios

🖥️ A Era dos Mainframes: Centralização e Poder Computacional

Os mainframes dominaram o cenário da computação empresarial desde a década de 1950 até meados dos anos 1980. Estas máquinas representavam investimentos significativos, frequentemente ocupando salas inteiras com sistemas de refrigeração dedicados e requisitos elétricos substanciais. O IBM System/360, lançado em 1964, estabeleceu padrões arquiteturais que influenciam sistemas até hoje.

A arquitetura centralizada dos mainframes baseava-se em um modelo computacional onde toda a capacidade de processamento residia em uma única máquina de grande porte. Terminais burros (dumb terminals) conectavam-se ao sistema central, funcionando essencialmente como dispositivos de entrada e saída sem capacidade de processamento local. Esta topologia criava dependência absoluta da disponibilidade do mainframe.

Anúncios

Características Técnicas dos Mainframes

Os mainframes apresentavam características únicas que os diferenciavam fundamentalmente dos sistemas que viriam posteriormente. A capacidade de processamento em lote (batch processing) permitia executar tarefas complexas durante períodos de menor demanda, otimizando a utilização de recursos computacionais extremamente caros.

A confiabilidade constituía requisito não-negociável. Sistemas como o IBM z/Series implementavam redundância em múltiplos níveis: processadores duplicados, caminhos de I/O alternativos, fontes de alimentação redundantes e mecanismos sofisticados de detecção e correção de erros. O conceito de “cinco noves” (99,999% de disponibilidade) tornou-se padrão para estas plataformas.

O throughput de transações dos mainframes permanece impressionante mesmo para padrões contemporâneos. Sistemas modernos como o IBM z15 podem processar mais de 1 trilhão de transações web diariamente, demonstrando a capacidade de escalabilidade vertical que caracteriza esta arquitetura.

⚙️ Limitações Arquiteturais do Modelo Centralizado

Apesar de suas capacidades técnicas impressionantes, o modelo centralizado apresentava limitações estruturais significativas. O custo por MIPS (milhões de instruções por segundo) em mainframes excedia em ordens de magnitude o custo equivalente em plataformas distribuídas emergentes.

A escalabilidade horizontal era praticamente inexistente. Aumentar a capacidade computacional requeria upgrades no hardware central, frequentemente envolvendo substituição completa de sistemas. Esta abordagem contrastava drasticamente com a possibilidade de simplesmente adicionar mais máquinas em arquiteturas distribuídas.

Desafios de Desenvolvimento e Manutenção

O desenvolvimento de software para mainframes exigia conhecimento altamente especializado. Linguagens como COBOL, PL/I e Assembler dominavam o ecossistema, com curvas de aprendizado acentuadas e ferramentas de desenvolvimento limitadas comparadas aos padrões modernos.

O ciclo de desenvolvimento caracterizava-se por processos longos e burocráticos. O acesso ao mainframe para testes era frequentemente restrito, com desenvolvedores submetendo jobs em lote e aguardando resultados que poderiam demorar horas ou dias. Esta latência no feedback inibia a experimentação e a iteração rápida.

💻 O Surgimento do Computador Pessoal: Democratização Tecnológica

O lançamento do Altair 8800 em 1975 marcou o início da revolução dos computadores pessoais, embora sistemas como o Apple II (1977) e o IBM PC (1981) tenham sido mais significativos comercialmente. O IBM PC, particularmente, estabeleceu uma arquitetura aberta que permitiu o florescimento de um ecossistema de hardware e software compatível.

A arquitetura do IBM PC baseava-se no processador Intel 8088, operando a 4,77 MHz com 16 KB de RAM expansíveis a 640 KB. Embora estas especificações pareçam primitivas para padrões contemporâneos, representavam capacidade computacional suficiente para aplicações pessoais e de pequenas empresas, a uma fração do custo de sistemas centralizados.

Inovações Arquiteturais dos PCs

Os PCs introduziram o conceito de processamento local distribuído. Cada máquina possuía capacidade autônoma de processamento, armazenamento e interface gráfica. Esta descentralização eliminava pontos únicos de falha e permitia escalabilidade horizontal através da simples adição de mais computadores.

A arquitetura aberta do PC contrastava radicalmente com os sistemas proprietários dos mainframes. O barramento ISA (Industry Standard Architecture) permitia que fabricantes terceiros desenvolvessem placas de expansão, criando um mercado competitivo que rapidamente reduziu custos e ampliou funcionalidades.

O sistema operacional tornou-se componente crítico nesta nova arquitetura. O MS-DOS, apesar de suas limitações técnicas, fornecia uma camada de abstração que permitia compatibilidade entre diferentes configurações de hardware. Esta padronização de software foi fundamental para a adoção massiva dos PCs.

🔄 Paradigmas de Computação em Transformação

A transição de mainframes para PCs não representou simplesmente uma mudança de hardware, mas uma transformação fundamental nos paradigmas de computação. O modelo time-sharing dos mainframes, onde múltiplos usuários compartilhavam recursos de um sistema central, deu lugar ao conceito de computação pessoal dedicada.

A interatividade transformou-se radicalmente. Mainframes operavam primariamente em modo batch ou através de terminais com interfaces baseadas em caracteres. PCs introduziram interfaces gráficas (GUI) que revolucionaram a usabilidade, com o Xerox Alto, Apple Lisa e eventualmente o Windows popularizando este paradigma.

Impactos na Arquitetura de Software

A arquitetura de software evoluiu para explorar as capacidades dos PCs. Aplicações monolíticas otimizadas para execução centralizada deram lugar a software modular projetado para hardware com recursos limitados mas dedicados. Técnicas de programação orientada a eventos tornaram-se prevalentes, contrastando com o processamento sequencial típico de mainframes.

O desenvolvimento de software acelerou dramaticamente. Compiladores executando localmente permitiam ciclos de edição-compilação-teste em minutos ao invés de horas. IDEs (Integrated Development Environments) como Turbo Pascal e posteriormente Visual Studio transformaram a produtividade dos desenvolvedores.

🌐 Networking e Computação Distribuída

O networking emergiu como tecnologia crítica que ampliou as capacidades dos PCs além de suas limitações individuais. Ethernet, desenvolvida no Xerox PARC e padronizada em 1983, forneceu a infraestrutura física para conectar computadores pessoais em redes locais (LANs).

Protocolos como TCP/IP, inicialmente desenvolvidos para a ARPANET, foram adaptados para PCs, criando a fundação técnica para a Internet. Esta conectividade permitiu arquiteturas cliente-servidor que combinavam o processamento distribuído dos PCs com a centralização seletiva de dados e recursos.

Modelos Cliente-Servidor: Híbrido Evolutivo

A arquitetura cliente-servidor representou uma síntese entre centralização e distribuição. Servidores de arquivo, servidores de banco de dados e servidores de aplicação concentravam recursos específicos, enquanto clientes executavam processamento local para interfaces e lógica de apresentação.

Esta arquitetura híbrida oferecia vantagens significativas: administração centralizada de dados, backup simplificado, segurança aprimorada, enquanto mantinha a responsividade e autonomia dos PCs. Sistemas de gerenciamento de banco de dados relacionais como Oracle, SQL Server e DB2 prosperaram neste modelo.

📊 Comparativo Técnico: Mainframes vs PCs

Uma análise técnica objetiva revela trade-offs fundamentais entre as arquiteturas. Mainframes continuam superiores em cenários específicos: processamento de transações de alta integridade, workloads de I/O intensivo, e aplicações que requerem disponibilidade extrema.

PCs e seus sucessores (workstations, servidores x86) dominam em cenários que beneficiam de processamento paralelo massivo, custos unitários reduzidos, e flexibilidade de configuração. A relação custo-desempenho para processamento genérico favorece dramaticamente a arquitetura distribuída.

Métricas de Desempenho Relevantes

O throughput de I/O constitui área onde mainframes mantêm vantagem significativa. Sistemas como o IBM z15 suportam até 32 canais de I/O operando a 25 Gbps cada, com latências extremamente baixas e consistentes. Esta capacidade é crítica para aplicações transacionais de larga escala.

Processamento paralelo em arquiteturas x86 evoluiu dramaticamente com múltiplos cores, hyper-threading e tecnologias como AVX (Advanced Vector Extensions). Um cluster de servidores x86 pode superar a capacidade bruta de processamento de mainframes a custos substancialmente menores para cargas de trabalho paralelizáveis.

🔧 Linguagens de Programação e Ferramentas

A transição de mainframes para PCs catalyzou a evolução das linguagens de programação. COBOL e PL/I, dominantes em mainframes, foram complementados e em muitos contextos substituídos por C, Pascal, e posteriormente C++, Java e linguagens de script.

A programação visual emergiu como paradigma possibilitado pelas capacidades gráficas dos PCs. Ferramentas como Visual Basic democratizaram o desenvolvimento de aplicações, permitindo que profissionais com conhecimento técnico limitado criassem software funcional através de interfaces drag-and-drop.

Evolução dos Ambientes de Desenvolvimento

IDEs modernos representam sofisticação incomparável comparada às ferramentas disponíveis na era dos mainframes. Funcionalidades como code completion, refactoring automatizado, debugging interativo e integração com sistemas de controle de versão transformaram a experiência do desenvolvedor.

O conceito de desenvolvimento ágil tornou-se viável apenas com a disponibilidade de recursos computacionais locais. Iterações rápidas, testes contínuos e deploys frequentes requerem a autonomia e flexibilidade que PCs e posteriormente workstations forneceram.

💼 Implicações Empresariais e Organizacionais

A descentralização tecnológica provocou transformações organizacionais profundas. Departamentos de TI centralizados, que controlavam rigidamente o acesso a recursos computacionais em mainframes, viram seu poder dispersar-se à medida que usuários adquiriam capacidade computacional independente.

O conceito de shadow IT emergiu desta democratização. Departamentos individuais começaram a implementar soluções baseadas em PCs sem envolvimento de TI central, criando desafios de governança mas também acelerando a inovação e adaptação às necessidades específicas de negócio.

Mudanças nos Modelos de Custo

A economia da computação transformou-se radicalmente. O modelo CAPEX (Capital Expenditure) intensivo dos mainframes, com investimentos iniciais massivos e depreciação de longo prazo, deu lugar a custos mais distribuídos e incrementais na era dos PCs.

O custo total de propriedade (TCO) tornou-se métrica crítica. Embora PCs individuais fossem baratos, a proliferação de milhares de máquinas introduzia complexidades de gerenciamento, suporte e manutenção que não existiam com sistemas centralizados.

🚀 Legado Técnico e Convergência Moderna

A dicotomia entre mainframes e PCs tornou-se menos pronunciada em décadas recentes. Conceitos de virtualização, originalmente desenvolvidos para mainframes na década de 1960, foram reimplementados em arquiteturas x86, permitindo consolidação e utilização eficiente de recursos.

Cloud computing representa uma síntese evolutiva, combinando centralização de infraestrutura com distribuição de processamento. Provedores como AWS, Azure e Google Cloud operam datacenters massivos que funcionalmente se assemelham a mainframes modernos, enquanto disponibilizam recursos computacionais distribuídos e elásticos.

Mainframes na Era Moderna

Contrariando previsões de obsolescência, mainframes persistem em setores específicos. Instituições financeiras, companhias de seguros e agências governamentais continuam dependendo destas plataformas para processar trilhões de transações críticas anualmente.

A integração entre mainframes legacy e arquiteturas modernas tornou-se especialidade técnica valiosa. APIs RESTful, containers Linux executando em z/OS, e integração com sistemas de mensageria modernos permitem que mainframes participem de arquiteturas híbridas contemporâneas.

🎯 Lições Arquiteturais para Sistemas Contemporâneos

A transição de mainframes para PCs oferece insights valiosos para arquitetos de sistemas modernos. A tensão fundamental entre centralização e distribuição permanece relevante ao projetar arquiteturas de microserviços, sistemas edge computing e plataformas IoT.

A importância de padrões abertos, demonstrada pelo sucesso da arquitetura IBM PC compatível, continua crítica. Ecossistemas tecnológicos prosperam quando múltiplos participantes podem inovar sobre fundações comuns, evitando lock-in proprietário.

A revolução que transformou a computação de mainframes para PCs não foi meramente tecnológica, mas fundamentalmente social e organizacional. Esta transição democratizou o acesso à tecnologia computacional, acelerou a inovação e redefiniu as possibilidades do que software e hardware poderiam alcançar. Profissionais técnicos contemporâneos beneficiam-se imensamente da compreensão desta evolução histórica, aplicando seus princípios arquiteturais aos desafios de design de sistemas distribuídos, cloud computing e infraestruturas híbridas que definem a computação moderna. 💡